OpenAI 悄悄更改“價值觀”:不 All in AGI 的別來沾邊

來源:量子位

圖片來源:由無界 AI生成

圖片來源:由無界 AI生成

OpenAI,悄然更改了核心價值觀(Core Values)。

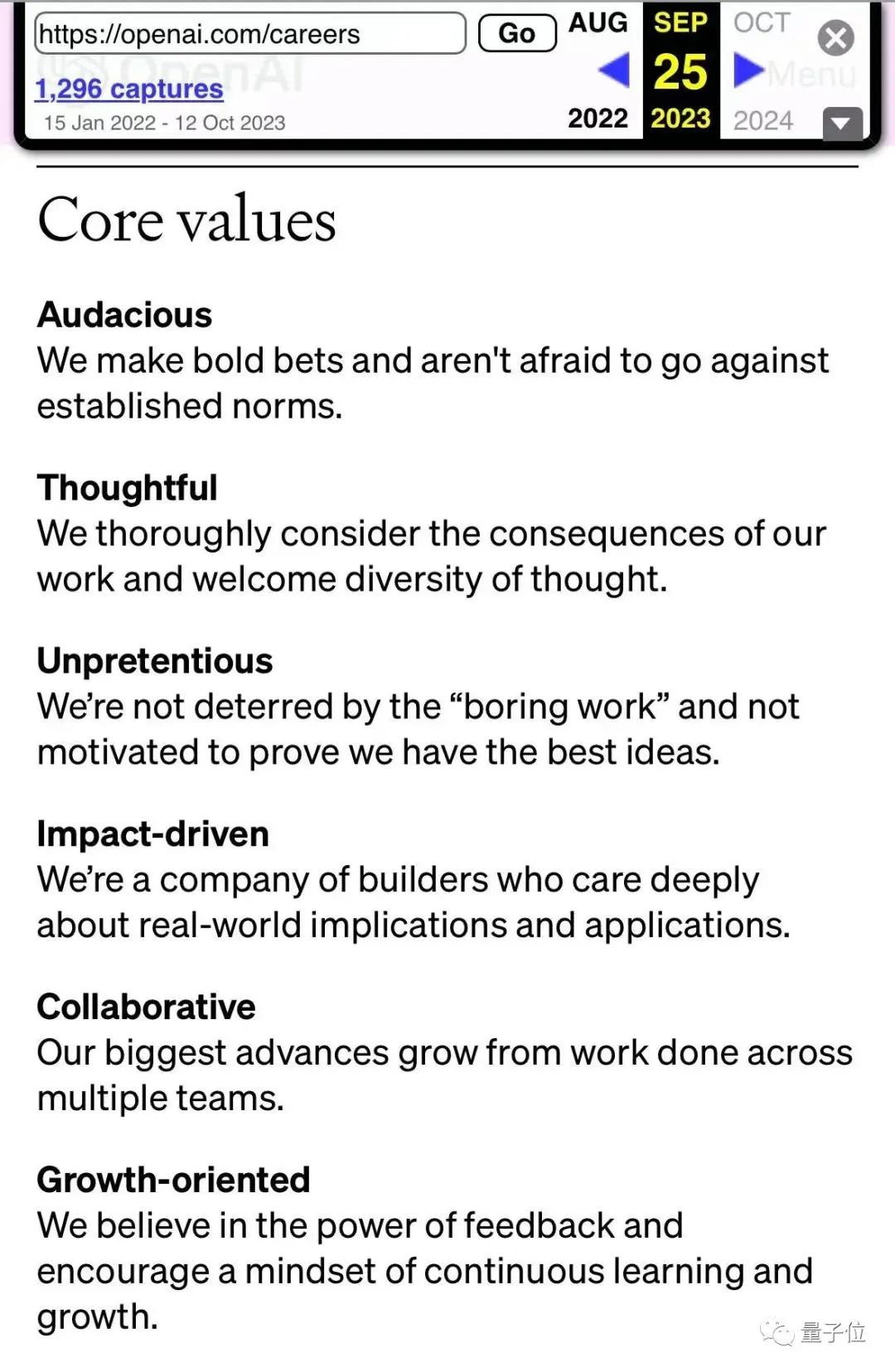

曾經的它,在自家官方網站中列出的六大核心價值觀是這樣的:

Audacious(大膽)、Thoughtful(深思熟慮)、Unpretentious(謙遜)、Impact-driven(影響力驅動)、Collaborative(協作)、Growth-oriented(成長型)。

現如今,若是再瀏覽官網,其核心價值觀已然發生了翻天覆地的變化。

現如今,若是再瀏覽官網,其核心價值觀已然發生了翻天覆地的變化。

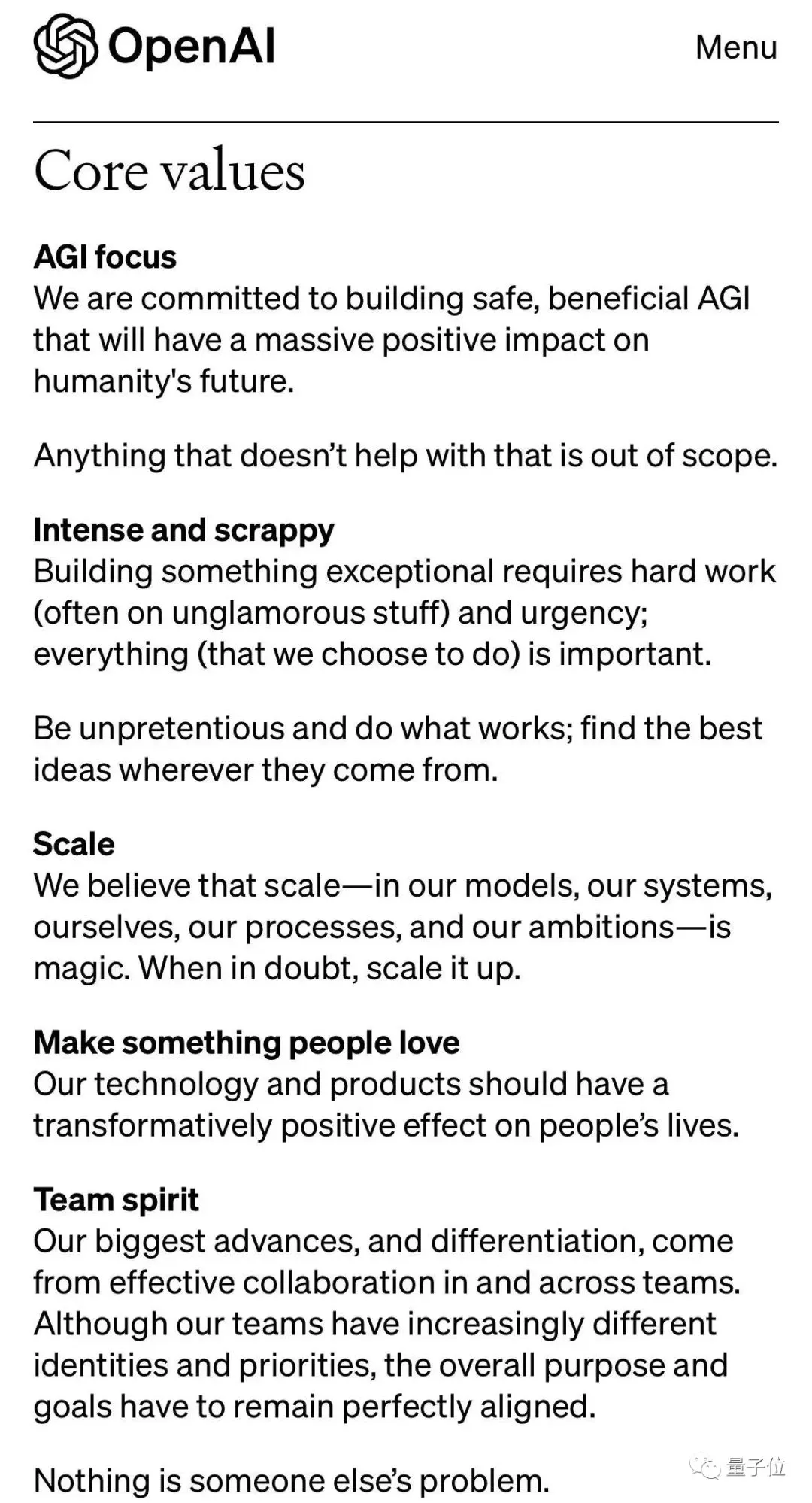

不僅從「六大」縮減到了「五大」,就連內容都換掉了:

AGI focus(聚焦AGI)、Intense and scrappy(熱切且鬥志昂揚)、Scale(規模化)、Make something people love(做人們喜歡的事物)、Team spirit(團隊精神)。

而且「AGI focus」赫然位列核心價值觀之首:

而且「AGI focus」赫然位列核心價值觀之首:

我們致力於建立安全、有益的AGI,這將對人類的未來產生巨大的積極影響。 我們致力於建立安全、有益的AGI,這將對人類的未來產生巨大的積極影響。

任何對此無濟於事的事情都超出了範圍。 任何對此沒有幫助的東西都不在討論範圍之內。

尤其是第二句,說得直白一些,就是“任何跟AGI無關的都別來沾邊”。

其實早已有跡可循

OpenAI對AGI如此重視也並不意外。

畢竟CEO Sam Altman已經不止一次對AGI做過評價,例如他曾在官網博客中把AGI描述為:

通常比人類更聰明的系統。

但在後續的採訪中,他將這個定義降級描述為:

相當於一個中等水準的人,你可以雇傭它作為同事。

** **△Sam Altman,由Midjourney生成

**△Sam Altman,由Midjourney生成

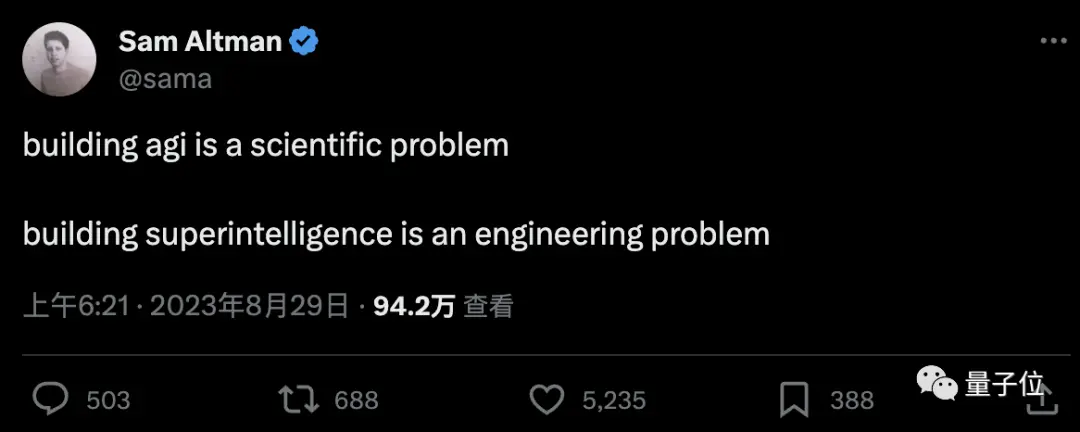

而且他在個人的 X(原推特)中,也經常談及對AGI的想法:

構建AGI是一個科學問題。

構建超級人工智慧是一個工程問題。

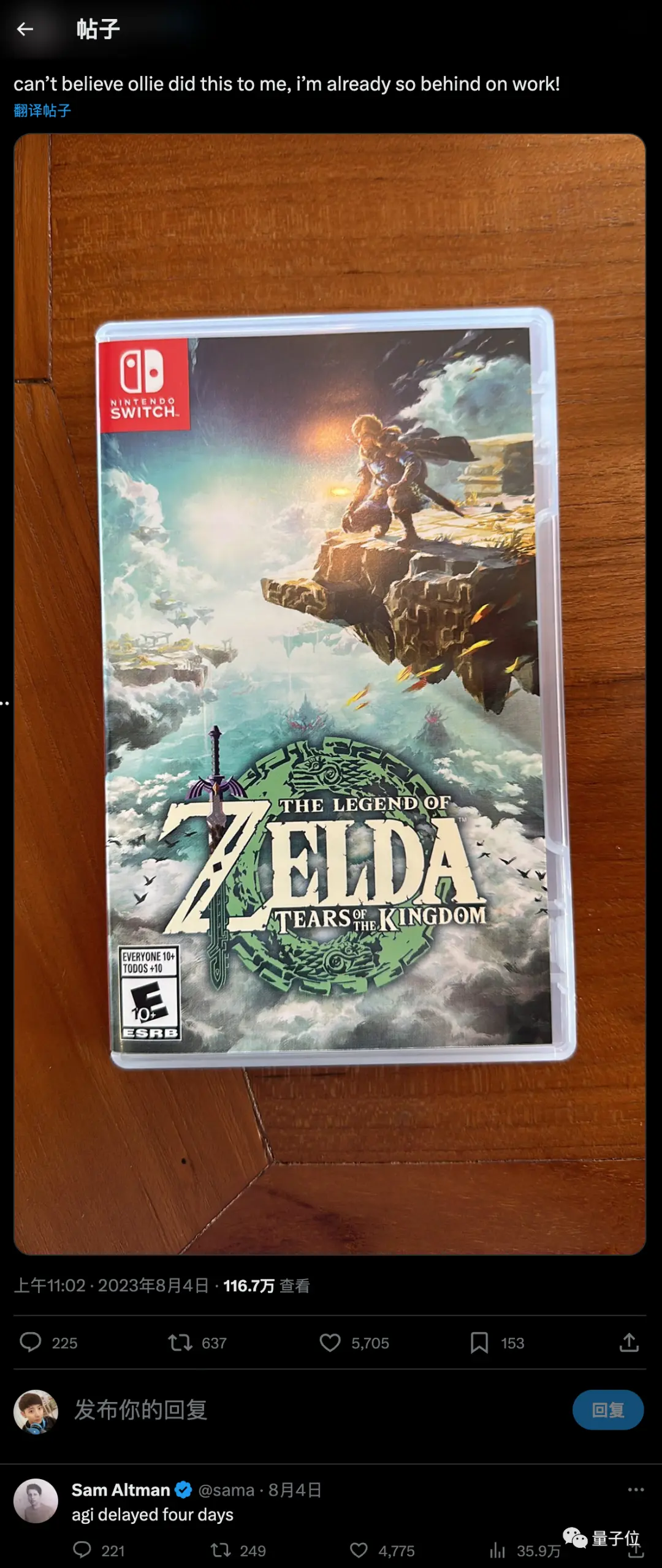

就連收到同事送的《塞爾達傳說》遊戲,在表示這款遊戲害得他落下許多工作之後,也不忘提一句AGI:

就連收到同事送的《塞爾達傳說》遊戲,在表示這款遊戲害得他落下許多工作之後,也不忘提一句AGI:

AGI延遲4天。

不過對於OpenAI更改核心價值觀這一行為,有人卻覺得很不OK:

不過對於OpenAI更改核心價值觀這一行為,有人卻覺得很不OK:

說改就改,這還是核心價值觀嗎?

但在OpenAI的發展歷程中,類似這樣的變化也並非第一次。

例如在最初2015年成立的時候,OpenAI還是一家非營利性研究實驗室,本質上意味著構建好的AI來對抗壞的AI。

後來在慢慢的發展過程中,OpenAI卻與“非營利性”逐漸背道而馳,這也導致馬斯克等人的陸續退出。

至於OpenAI的使命和願景,自2018年發佈以來至今卻沒有變過,依舊是:

確保通用人工智慧(AGI)造福全人類。

那麼對於此次更改核心價值觀這件事,你怎麼看呢?

參考連結:

[1]

[2]

[3