OpenAI change tranquillement les « valeurs » : ne vous mêlez pas de tout dans l’AGI

Source: Qubits

Source de l’image : Générée par Unbounded AI

Source de l’image : Générée par Unbounded AI

OpenAI, a discrètement changé les valeurs fondamentales.

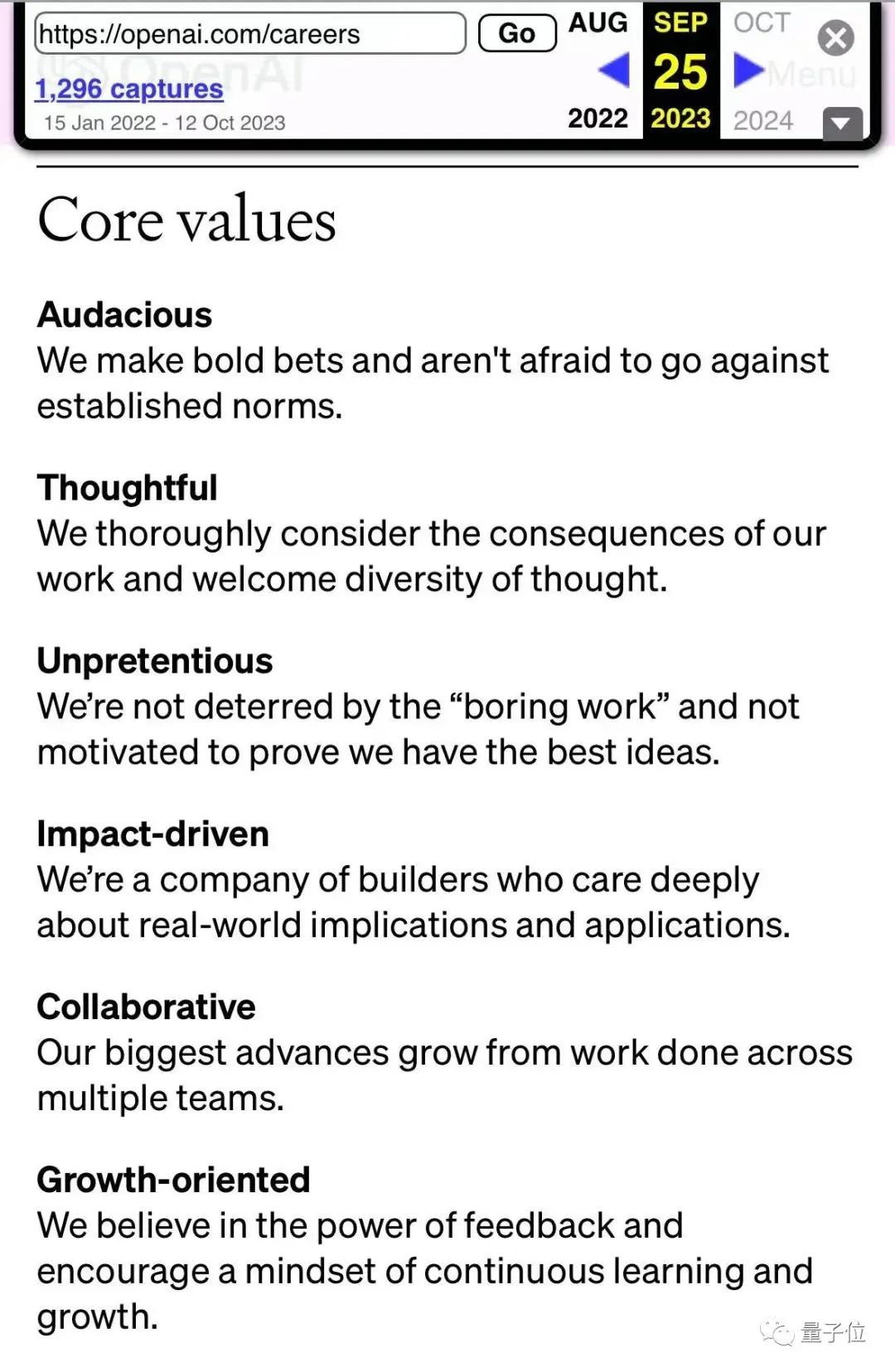

Dans le passé, les six valeurs fondamentales énumérées sur son site officiel étaient les suivantes :

Audacieux, réfléchi, sans prétention, axé sur l’impact, collaboratif et axé sur la croissance.

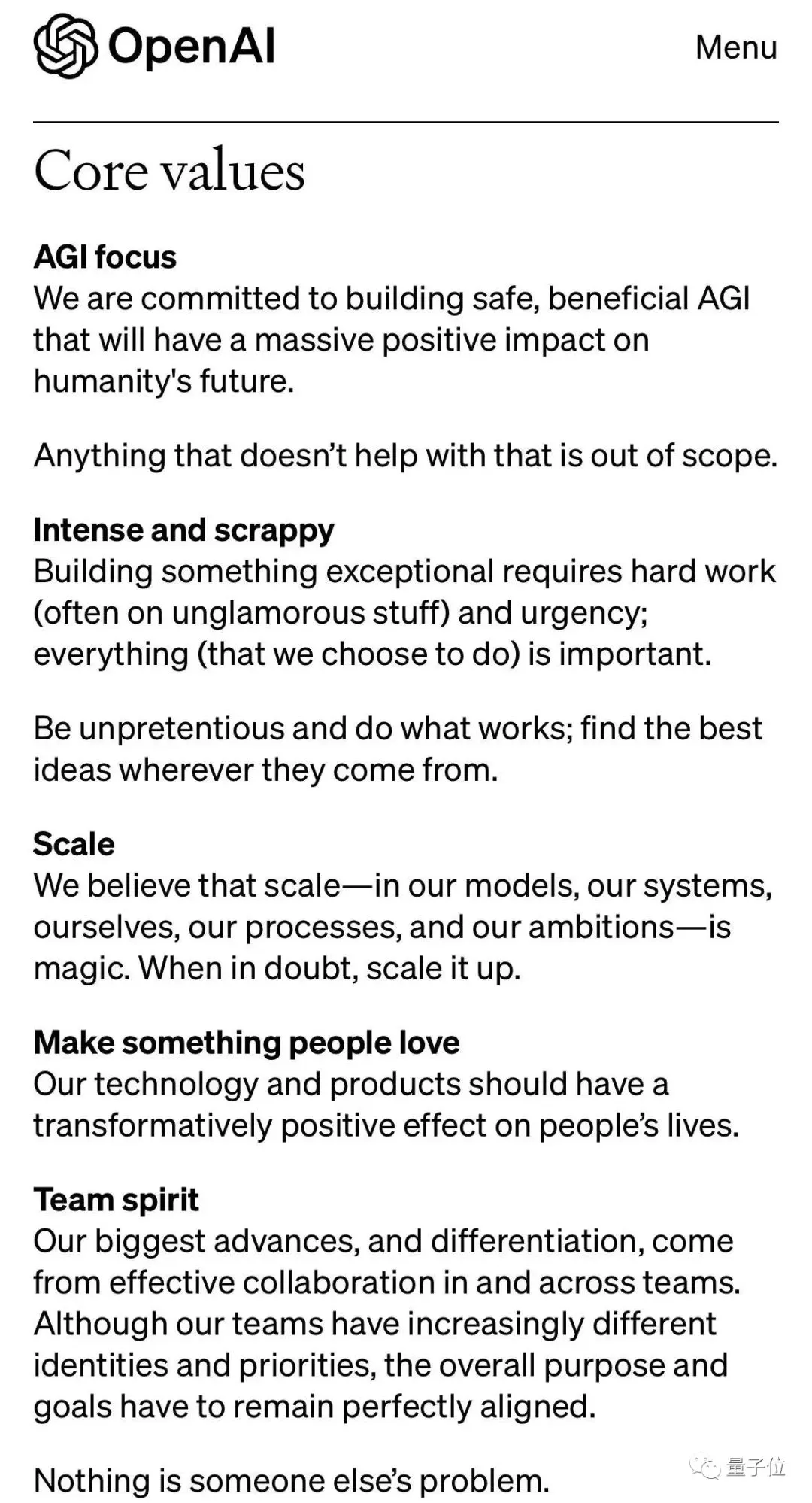

De nos jours, si vous naviguez sur le site officiel, ses valeurs fondamentales ont radicalement changé.

De nos jours, si vous naviguez sur le site officiel, ses valeurs fondamentales ont radicalement changé.

Non seulement il a été réduit de « Big Six » à « Big Five », mais même le contenu a été remplacé :

Focus AGI, Intense et décousu, Échelle, Faire quelque chose que les gens aiment, Esprit d’équipe.

Et « AGI focus » se démarque en tête de liste des valeurs fondamentales :

Et « AGI focus » se démarque en tête de liste des valeurs fondamentales :

Nous nous engageons à mettre en place des IAG sûres et bénéfiques qui auront un impact positif massif sur l’avenir de l’humanité.

Nous nous engageons à créer des institutions financières sûres et gratifiantes qui auront un impact extrêmement positif sur l’avenir de l’humanité.

Tout ce qui n’aide pas à cela est hors du champ d’application.

Tout ce qui n’aide pas à cela est en dehors du cadre de la discussion.

En particulier, la deuxième phrase, pour le dire crûment, est « tout ce qui n’a rien à voir avec l’IAG ne doit pas être touché ».

En fait, il y a déjà des traces

Il n’est pas surprenant qu’OpenAI prenne l’AGI si au sérieux.

Après tout, le PDG Sam Altman a commenté AGI plus d’une fois, par exemple, il a décrit AGI dans son article de blog officiel :

Des systèmes qui sont généralement plus intelligents que les humains.

Mais dans une interview de suivi, il a déclassé cette définition comme suit :

est l’équivalent d’une personne de niveau moyen, que vous pouvez embaucher en tant que collègue.

** Sam Altman, généré par Midjourney

Sam Altman, généré par Midjourney

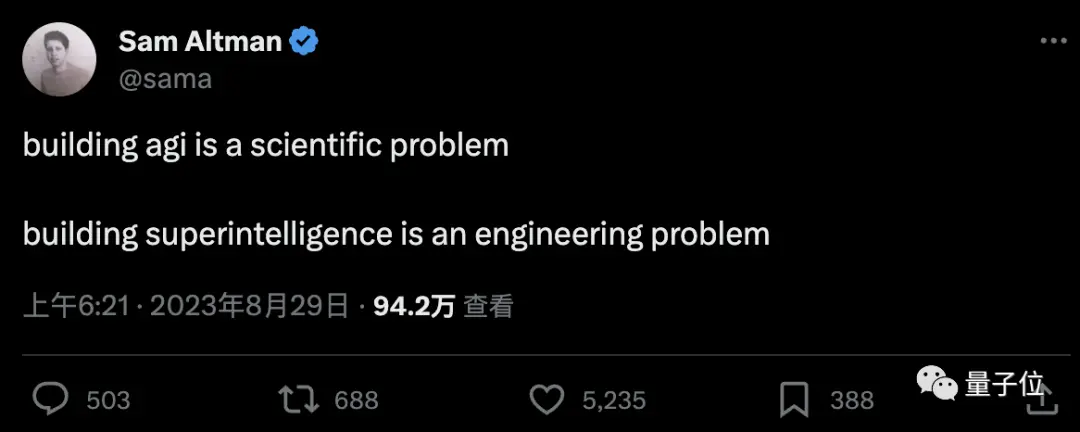

Et dans son X personnel (anciennement Twitter), il parle souvent de ses réflexions sur AGI :

Construire une IAG est une question scientifique.

La construction d’une super IA est un problème d’ingénierie.

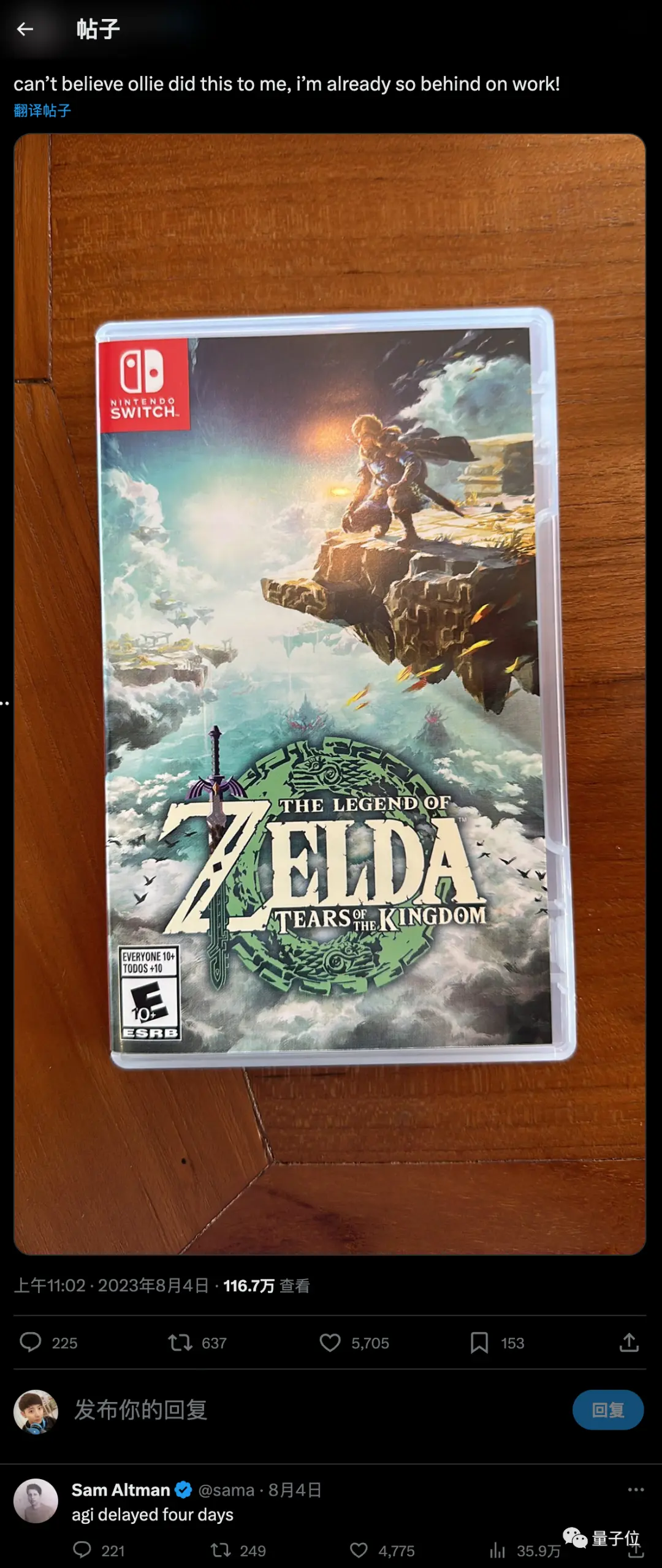

Même après avoir reçu le jeu « The Legend of Zelda » d’un collègue, après avoir dit que ce jeu lui avait fait perdre beaucoup de travail, il n’a pas oublié de mentionner AGI :

Même après avoir reçu le jeu « The Legend of Zelda » d’un collègue, après avoir dit que ce jeu lui avait fait perdre beaucoup de travail, il n’a pas oublié de mentionner AGI :

'AGI est retardé de 4 jours.

Cependant, certaines personnes pensent que le comportement d’OpenAI consistant à changer ses valeurs fondamentales est très inacceptable :

Cependant, certaines personnes pensent que le comportement d’OpenAI consistant à changer ses valeurs fondamentales est très inacceptable :

le changement est toujours une valeur fondamentale ?

Mais ce n’est pas la première fois dans l’histoire d’OpenAI.

Par exemple, lorsqu’il a été fondé en 2015, OpenAI était un laboratoire de recherche à but non lucratif, c’est-à-dire qu’il s’agissait essentiellement de créer une bonne IA pour lutter contre la mauvaise IA.

Plus tard, dans le processus de développement lent, OpenAI s’est progressivement heurté à l’opposition à « non-profit », ce qui a également conduit Musk et d’autres à se retirer l’un après l’autre.

Quant à la mission et à la vision d’OpenAI, elle n’a pas changé depuis sa sortie en 2018, et elle reste la même :

Veiller à ce que l’intelligence artificielle à usage général (AGI) profite à l’ensemble de l’humanité.

Que pensez-vous de ce changement de valeurs fondamentales ?

Lien de référence :

[1]

[2]

[3