GateUser-63337a2a

如何参与成长积分抽奖?

在Gate Square“社区中心”完成任务以获得成长积分,然后可以用成长积分进行抽奖。每300成长积分获得一次抽奖机会。

#AprilMarketOutlook #Gate@Gate

查看原文在Gate Square“社区中心”完成任务以获得成长积分,然后可以用成长积分进行抽奖。每300成长积分获得一次抽奖机会。

#AprilMarketOutlook #Gate@Gate

- 赞赏

- 点赞

- 评论

- 转发

- 分享

最近这几天,有很多1000U左右小资金的朋友都在问,怎么做滚到5000U甚至1万U。

其实小紫斤最忌讳的不是赚得慢,而是去得快。满苍、重苍、高杠杆想一把翻倍,往往几单就归零。想滚起来,核心就是先活下来。

初期用200-300U试苍,苍位别过半,只做趋势清晰、有支撑压力、止损明确的行情。每丹亏损控制在50-70U,别嫌少,一次大亏就足以废掉账户。止莹不贪,小波段及时落代。

等紫斤做到3000U再适当提速,风险依旧控制在3%-5%。小紫斤先保命,中等资斤再提速,做大后守利润。记得适时出斤,心态才稳。

交意没有捷径,控苍、止损、严格执行,慢慢滚才能真正做大。#比特币跳水29万人爆仓##币圈##区块链 #BTC☀

其实小紫斤最忌讳的不是赚得慢,而是去得快。满苍、重苍、高杠杆想一把翻倍,往往几单就归零。想滚起来,核心就是先活下来。

初期用200-300U试苍,苍位别过半,只做趋势清晰、有支撑压力、止损明确的行情。每丹亏损控制在50-70U,别嫌少,一次大亏就足以废掉账户。止莹不贪,小波段及时落代。

等紫斤做到3000U再适当提速,风险依旧控制在3%-5%。小紫斤先保命,中等资斤再提速,做大后守利润。记得适时出斤,心态才稳。

交意没有捷径,控苍、止损、严格执行,慢慢滚才能真正做大。#比特币跳水29万人爆仓##币圈##区块链 #BTC☀

BTC2.94%

- 赞赏

- 2

- 评论

- 转发

- 分享

芝麻开门

芝麻开门

创建人@阿宇A

认购进度

0.00%

市值:

$0

更多代币

抱歉,您提供的源文本为随机字符和无意义的字符串,无法进行合理的翻译。

查看原文

- 赞赏

- 点赞

- 评论

- 转发

- 分享

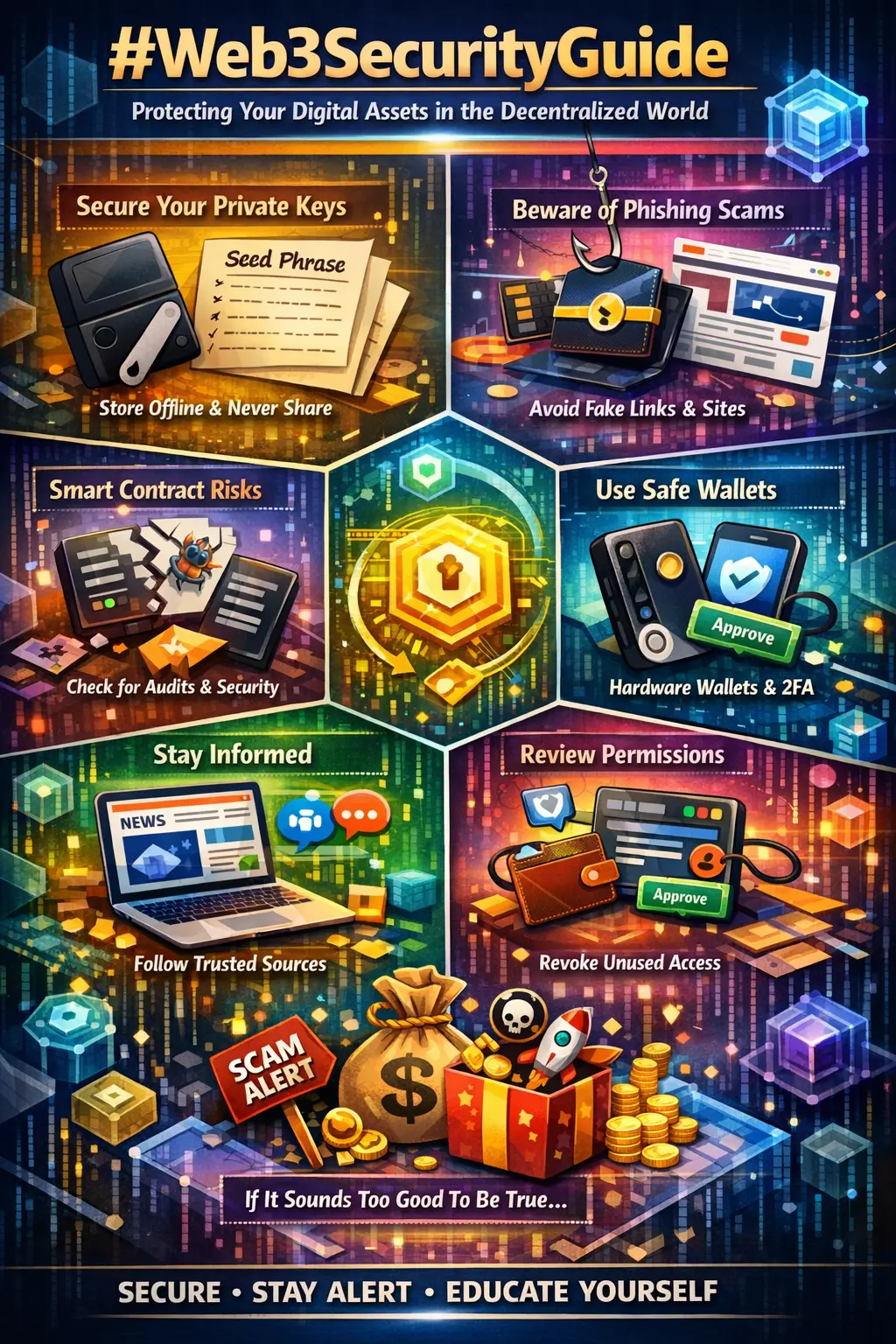

#Web3SecurityGuide 在快速发展的Web3世界中,去中心化赋予用户对其数字资产的完全控制权,安全性变得比以往任何时候都更为重要。与传统系统中机构可以逆转交易或找回丢失资金不同,Web3将责任直接交到用户手中。这一转变带来了自由,但也伴随着风险。了解如何在这个生态系统中保护自己,对于任何与加密货币、NFT或去中心化应用互动的人来说都是必不可少的。

Web3安全的核心是私钥所有权的概念。你的私钥本质上是你数字钱包的主钥。如果有人获得了它,他们就可以完全控制你的资金。这就是为什么绝对不能与任何人分享你的私钥或助记词。将其安全地离线存储,比如在硬件钱包中,或写在纸上并放在安全的地方,是防止盗窃的最有效方法之一。

钓鱼攻击是Web3中的另一个主要威胁。骗子常常创建假网站、电子邮件或社交媒体账户,模仿合法平台,诱使用户泄露敏感信息。在连接钱包之前务必仔细核对网址,避免点击可疑链接。即使是一个小错误,比如访问了一个流行平台的假冒版本,也可能导致资金无法挽回的损失。

智能合约,作为去中心化应用的基础,也可能成为潜在的漏洞点。虽然它们设计为无需中介即可自动执行,但编写不当或未经审计的智能合约可能被黑客利用。在与任何新项目互动之前,明智的做法是查阅其智能合约是否已由信誉良好的安全公司进行审计。透明度和社区信任是衡量项目可信度的重要指标。

使用安全的钱包是另一层重要的保护措施。硬件钱包通

查看原文Web3安全的核心是私钥所有权的概念。你的私钥本质上是你数字钱包的主钥。如果有人获得了它,他们就可以完全控制你的资金。这就是为什么绝对不能与任何人分享你的私钥或助记词。将其安全地离线存储,比如在硬件钱包中,或写在纸上并放在安全的地方,是防止盗窃的最有效方法之一。

钓鱼攻击是Web3中的另一个主要威胁。骗子常常创建假网站、电子邮件或社交媒体账户,模仿合法平台,诱使用户泄露敏感信息。在连接钱包之前务必仔细核对网址,避免点击可疑链接。即使是一个小错误,比如访问了一个流行平台的假冒版本,也可能导致资金无法挽回的损失。

智能合约,作为去中心化应用的基础,也可能成为潜在的漏洞点。虽然它们设计为无需中介即可自动执行,但编写不当或未经审计的智能合约可能被黑客利用。在与任何新项目互动之前,明智的做法是查阅其智能合约是否已由信誉良好的安全公司进行审计。透明度和社区信任是衡量项目可信度的重要指标。

使用安全的钱包是另一层重要的保护措施。硬件钱包通

- 赞赏

- 4

- 7

- 转发

- 分享

GateUser-68291371 :

:

紧紧握住 💪查看更多

- 赞赏

- 点赞

- 评论

- 转发

- 分享

【$ALGO 信号】轧空结构确立,回踩即上车机会

$ALGO 1H级别冲高后强势横盘,RSI飙到90.26,4小时布林带直接冲出上轨。买盘深度厚实,0.104下方挂单墙极厚,主力托底意图太明显了。

🎯方向:做多

⚡入场/挂单:0.0943 - 0.0967

🛑止损:0.0913

🚀目标1:0.1184

🚀目标2:0.1292

🛡️交易管理:

- 执行策略:到达目标1后减仓50%,并将止损上移至保本位 。若价格跌回入场位,自动离场,保护本金。

4小时MACD柱状线持续扩张,趋势动能强劲。持仓量保持稳定,价格拉涨时并未伴随资金出逃,这是强势市场的特征。1小时级别在0.099附近反复测试后迅速拉起,抛压被快速消化。当前盈亏比超过4,这个位置的回踩埋伏,风险可控。

查看实时行情 👇 $ALGO

---

关注我:获取更多加密市场实时分析与洞察! $BTC $ETH $SOL

#四月行情预测 #加密市场普遍上涨 #金银同步走强

$ALGO 1H级别冲高后强势横盘,RSI飙到90.26,4小时布林带直接冲出上轨。买盘深度厚实,0.104下方挂单墙极厚,主力托底意图太明显了。

🎯方向:做多

⚡入场/挂单:0.0943 - 0.0967

🛑止损:0.0913

🚀目标1:0.1184

🚀目标2:0.1292

🛡️交易管理:

- 执行策略:到达目标1后减仓50%,并将止损上移至保本位 。若价格跌回入场位,自动离场,保护本金。

4小时MACD柱状线持续扩张,趋势动能强劲。持仓量保持稳定,价格拉涨时并未伴随资金出逃,这是强势市场的特征。1小时级别在0.099附近反复测试后迅速拉起,抛压被快速消化。当前盈亏比超过4,这个位置的回踩埋伏,风险可控。

查看实时行情 👇 $ALGO

---

关注我:获取更多加密市场实时分析与洞察! $BTC $ETH $SOL

#四月行情预测 #加密市场普遍上涨 #金银同步走强

- 赞赏

- 1

- 评论

- 转发

- 分享

我的账号是 ***********

- 赞赏

- 点赞

- 评论

- 转发

- 分享

BTC-ETH-SOL专场

- 赞赏

- 点赞

- 评论

- 转发

- 分享

晚间行情

- 赞赏

- 点赞

- 评论

- 转发

- 分享

NBA

NBA

创建人@柏仔666

认购进度

0.00%

市值:

$0

更多代币

每日大盘解读——BTC

关于BTC当前位置的波动性质,我的思路和看法一向都是连贯且明确的,就是:

在日K未能收复MA30之前,价格反抽MA30看压制;后续即使收复,由于是在空头一侧的上涨,只会加大其中的抛压,不能追涨,只预留急涨后的背驰急跌即可。

从日线及以上级别的结构来看,价格处于空头趋势当中第二个下跌横盘的空头一侧,当前走势的性质,是横盘内部构建“类M顶”之后,对其颈线位置的反抽确认。

未有效收复MA30之前的一切反抽,均看压制。所以日线的现有结构,主要预留价格以MA30为高点,反复几次之后的变盘下行思路。

从4H到12H的中线走势来看,4H MA250和12H MA30对价格形成了弱压制的效果,日内的反弹高点,停留在前文提及的684-700的上涨阻力区域,该位置无论涨跌,都处于极窄幅的范围内,没有多少操作空间和稳定性。

安全的模式,就是等价格刷新过去10天的高低点之后,做产生离开段之后的反向。

从1H及以下级别的走势来看,由于大级别是下跌横盘,且近期走势又处于横盘的中下轨区域,所以现价及上方都具有形态的压制或背驰抛压点;即使内部形成短线支撑,在大级别的共振压制之下,也很难有良好的表现,对多军而言,不操作也是一种很好的操作。

短线压制69519-70270,第二压制71099-72612,形态背驰区域73910-76300

就近的短线支撑个人暂时选择放弃,以下是3个月内一直有效

关于BTC当前位置的波动性质,我的思路和看法一向都是连贯且明确的,就是:

在日K未能收复MA30之前,价格反抽MA30看压制;后续即使收复,由于是在空头一侧的上涨,只会加大其中的抛压,不能追涨,只预留急涨后的背驰急跌即可。

从日线及以上级别的结构来看,价格处于空头趋势当中第二个下跌横盘的空头一侧,当前走势的性质,是横盘内部构建“类M顶”之后,对其颈线位置的反抽确认。

未有效收复MA30之前的一切反抽,均看压制。所以日线的现有结构,主要预留价格以MA30为高点,反复几次之后的变盘下行思路。

从4H到12H的中线走势来看,4H MA250和12H MA30对价格形成了弱压制的效果,日内的反弹高点,停留在前文提及的684-700的上涨阻力区域,该位置无论涨跌,都处于极窄幅的范围内,没有多少操作空间和稳定性。

安全的模式,就是等价格刷新过去10天的高低点之后,做产生离开段之后的反向。

从1H及以下级别的走势来看,由于大级别是下跌横盘,且近期走势又处于横盘的中下轨区域,所以现价及上方都具有形态的压制或背驰抛压点;即使内部形成短线支撑,在大级别的共振压制之下,也很难有良好的表现,对多军而言,不操作也是一种很好的操作。

短线压制69519-70270,第二压制71099-72612,形态背驰区域73910-76300

就近的短线支撑个人暂时选择放弃,以下是3个月内一直有效

BTC2.94%

- 赞赏

- 1

- 评论

- 转发

- 分享

- 赞赏

- 点赞

- 评论

- 转发

- 分享

InfoFi 回来了?

第三条线引起了我的注意 😭

查看原文第三条线引起了我的注意 😭

- 赞赏

- 点赞

- 评论

- 转发

- 分享

如果一个平台把发推变成资产分配入口,它就不再是内容工具。

@easydotfunX 的核心,是把社交行为直接纳入链上激励体系。用户在 X 上的互动、内容输出、参与任务,被映射为积分或权益,再与后续代币分配绑定。这种设计看似常见,但关键在于执行路径是否足够轻,以及分配是否真实有效。

本质上,它在做的是注意力定价。

不是谁资金多,而是谁能持续制造有效信息。内容、互动、传播,被压缩成一个可计算的价值函数。这种模型一旦成立,社交行为就不再是副产品,而是生产要素。

但问题同样清晰,一旦激励强于内容本身,系统就会被刷量行为侵蚀。算法如果无法区分真实影响力与伪造互动,整个分配体系会迅速失真。

从交易者视角看,这类项目的关键不在机制设计,而在筛选能力。

能筛选才有价值沉淀,不能筛选只是短期流量放大器。

@easydotfunX @wallchain #Ad #Affiliate @TermMaxFi

@easydotfunX 的核心,是把社交行为直接纳入链上激励体系。用户在 X 上的互动、内容输出、参与任务,被映射为积分或权益,再与后续代币分配绑定。这种设计看似常见,但关键在于执行路径是否足够轻,以及分配是否真实有效。

本质上,它在做的是注意力定价。

不是谁资金多,而是谁能持续制造有效信息。内容、互动、传播,被压缩成一个可计算的价值函数。这种模型一旦成立,社交行为就不再是副产品,而是生产要素。

但问题同样清晰,一旦激励强于内容本身,系统就会被刷量行为侵蚀。算法如果无法区分真实影响力与伪造互动,整个分配体系会迅速失真。

从交易者视角看,这类项目的关键不在机制设计,而在筛选能力。

能筛选才有价值沉淀,不能筛选只是短期流量放大器。

@easydotfunX @wallchain #Ad #Affiliate @TermMaxFi

- 赞赏

- 点赞

- 评论

- 转发

- 分享

#ClaudeCode500KCodeLeak 过去的24小时对整个AI行业来说是一次现实检验。所谓的Claude庞大内部代码库泄露不仅仅是又一次技术失误——它是一个信号,一个警示,坦白说,也是一个将炒作与纪律区分开的时刻。对于一个自诩为AI安全黄金标准的公司来说,这次事件的影响不同寻常。它提出了一个简单但令人不舒服的问题:如果“最注重安全”的实验室都能在这个规模上出错,那么整个AI竞赛的基础有多安全?

在我看来,这不仅仅关乎一家公司犯了错误。这关乎AI领域的快速发展与这些组织实际应对速度的差距。每个人都在竞争打造更智能、更快、更强大的模型——但安全、内部控制和操作纪律往往落后于创新。当它们落后时,就会发生类似的事件。

让这个情况更有趣的是规模。我们不是在谈论一个小漏洞或一次数据泄露。这是核心知识产权、数年的研究、工程决策和系统架构的潜在曝光。这会在一夜之间改变竞争格局。它降低了竞争者的门槛,加快了逆向工程,甚至可能重塑未来AI模型的构建方式。

但我更强烈的观点是——我不认为这会减缓AI的发展。反而,它会加快步伐。这类泄露往往会引发连锁反应。开发者学习得更快,小团队获得平时无法接触的洞察,创新变得更加去中心化。从某种奇怪的角度来看,这类事件无意中可以实现技术的民主化。

当然,也有阴暗面。安全风险增加。恶意行为者可以获取先进的框架。信任因素——在AI中本已脆弱——又受到打击。用户、投

查看原文在我看来,这不仅仅关乎一家公司犯了错误。这关乎AI领域的快速发展与这些组织实际应对速度的差距。每个人都在竞争打造更智能、更快、更强大的模型——但安全、内部控制和操作纪律往往落后于创新。当它们落后时,就会发生类似的事件。

让这个情况更有趣的是规模。我们不是在谈论一个小漏洞或一次数据泄露。这是核心知识产权、数年的研究、工程决策和系统架构的潜在曝光。这会在一夜之间改变竞争格局。它降低了竞争者的门槛,加快了逆向工程,甚至可能重塑未来AI模型的构建方式。

但我更强烈的观点是——我不认为这会减缓AI的发展。反而,它会加快步伐。这类泄露往往会引发连锁反应。开发者学习得更快,小团队获得平时无法接触的洞察,创新变得更加去中心化。从某种奇怪的角度来看,这类事件无意中可以实现技术的民主化。

当然,也有阴暗面。安全风险增加。恶意行为者可以获取先进的框架。信任因素——在AI中本已脆弱——又受到打击。用户、投

- 赞赏

- 点赞

- 评论

- 转发

- 分享

真正让人上瘾的不是收益而是“感觉自己在赚钱”,@Hypercroc_xyz 把这点做得很极致。

你几乎不需要理解策略,不需要切换复杂界面,不需要频繁操作。你只做一件事,存进去,然后看 XP 和等级慢慢往上爬。时间越长,倍率越高,NFT 再给你加成,这种设计本质是在强化一个反馈循环。

这不是 DeFi,这更像游戏,问题是这种体验正在成为趋势。

过去一代 DeFi 拼的是协议设计,现在拼的是行为设计。谁能让用户留下来,谁就能拿走流动性。Hypercroc 用的是最直接的一种方式,把收益预期拆成可视化进度,让用户持续获得正反馈。

但你如果往深一点看会发现一个更大的变化,DeFi 正在从“操作复杂但透明”,转向“体验简单但黑箱”。

Hypercroc 的策略组合是标准的量化框架,动量、套利、均值回归这些词都很熟,但普通用户其实无法验证这些策略是否真的在执行,或者执行效果如何。

这就是关键矛盾,用户要简单,系统却变复杂,所以未来的分化会很明显。

一类协议走透明化,所有数据链上验证,另一类走产品化,用体验换信任。

Hypercroc 明显站在后者,如果它能证明收益真实且稳定,它会成为下一阶段资金入口,如果不能,它会被市场快速清算。

你能不能赚钱,取决于一件事,你是把它当产品在用,还是当叙事在交易。

@Hypercroc_xyz $CROC @easydotfunX @wallchain #Ad

你几乎不需要理解策略,不需要切换复杂界面,不需要频繁操作。你只做一件事,存进去,然后看 XP 和等级慢慢往上爬。时间越长,倍率越高,NFT 再给你加成,这种设计本质是在强化一个反馈循环。

这不是 DeFi,这更像游戏,问题是这种体验正在成为趋势。

过去一代 DeFi 拼的是协议设计,现在拼的是行为设计。谁能让用户留下来,谁就能拿走流动性。Hypercroc 用的是最直接的一种方式,把收益预期拆成可视化进度,让用户持续获得正反馈。

但你如果往深一点看会发现一个更大的变化,DeFi 正在从“操作复杂但透明”,转向“体验简单但黑箱”。

Hypercroc 的策略组合是标准的量化框架,动量、套利、均值回归这些词都很熟,但普通用户其实无法验证这些策略是否真的在执行,或者执行效果如何。

这就是关键矛盾,用户要简单,系统却变复杂,所以未来的分化会很明显。

一类协议走透明化,所有数据链上验证,另一类走产品化,用体验换信任。

Hypercroc 明显站在后者,如果它能证明收益真实且稳定,它会成为下一阶段资金入口,如果不能,它会被市场快速清算。

你能不能赚钱,取决于一件事,你是把它当产品在用,还是当叙事在交易。

@Hypercroc_xyz $CROC @easydotfunX @wallchain #Ad

- 赞赏

- 1

- 评论

- 转发

- 分享

加载更多