Vòng tròn mô hình lớn đang thảo luận sôi nổi về "GPU kém": Có thông tin cho rằng Google có sức mạnh tính toán cao hơn các công ty khác cộng lại, điều này khiến các công ty khởi nghiệp lo lắng.

Nguồn: Qubit

Khi tôi thức dậy qua đêm, có một từ nóng trong vòng tròn mô hình lớn - “GPU-Poor” (GPU-Poor).

Báo cáo từ SemiAnalysis, một tổ chức phân tích ngành, tiết lộ rằng Google có nhiều tài nguyên điện toán hơn OpenAI, Meta, Amazon, Oracle và CoreWeave cộng lại.

Nhà phân tích Dylan Patel dự đoán rằng vào cuối năm nay, khối lượng đào tạo của Gemini, mô hình lớn thế hệ tiếp theo do Google DeepMind cùng phát triển, sẽ đè bẹp (Đập vỡ) GPT-4 5 lần.

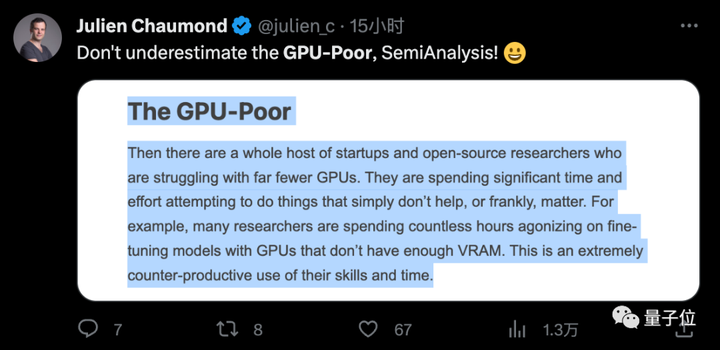

Báo cáo chỉ ra rằng trước lợi thế vượt trội này, hầu hết các công ty khởi nghiệp và lực lượng nguồn mở đều trở nên “nghèo GPU” và đang phải vật lộn với nguồn lực hạn chế.

Câu nói vừa bắt mắt vừa đau lòng này nhanh chóng trở thành một meme mới và lan truyền trong ngành.

Julien Chaumond, đồng sáng lập của HuggingFace, lãnh đạo nguồn mở được nêu tên, nói: Đừng đánh giá thấp chúng tôi, những người nghèo.

“Người nghèo GPU” đang làm những việc vô ích

Báo cáo rất không thương tiếc, thẳng thừng nói rằng nhiều công ty khởi nghiệp tốn rất nhiều thời gian và sức lực trong trường hợp thiếu GPU, Vô ích.

Ví dụ: nhiều người muốn sử dụng đầu ra của mô hình lớn để tinh chỉnh mô hình nhỏ, sau đó đi quét bảng xếp hạng, nhưng phương pháp đánh giá không hoàn hảo và chú ý nhiều hơn đến phong cách hơn là độ chính xác hoặc tính thực tế.

Báo cáo cũng tin rằng bản thân việc xếp hạng với nhiều tiêu chuẩn đo lường khác nhau cũng gây hiểu lầm cho các công ty nhỏ, dẫn đến một số lượng lớn các mô hình không thực tế, cũng là một dạng gây hại cho phong trào nguồn mở.

Mặt khác, những người nghèo GPU thay vì sử dụng tài nguyên một cách hiệu quả, hầu hết họ sử dụng các mô hình chuyên sâu, chủ yếu dựa trên hệ sinh thái alpaca nguồn mở.

Tuy nhiên, những gã khổng lồ như OpenAI và Google đã chơi với các mô hình thưa thớt** chẳng hạn như kiến trúc MoE và sử dụng các mô hình nhỏ** lấy mẫu suy đoán (giải mã suy đoán) để cải thiện hiệu quả suy luận, hoàn toàn là hai trò chơi.

Tác giả hy vọng những người nghèo GPU không nên giới hạn quá mức kích thước mô hình và định lượng quá mức, đồng thời bỏ qua sự suy giảm chất lượng mô hình. Nó nên tập trung vào việc cung cấp hiệu quả các mô hình tinh chỉnh trên cơ sở hạ tầng dùng chung, giảm độ trễ và yêu cầu về băng thông bộ nhớ để đáp ứng nhu cầu của điện toán biên.

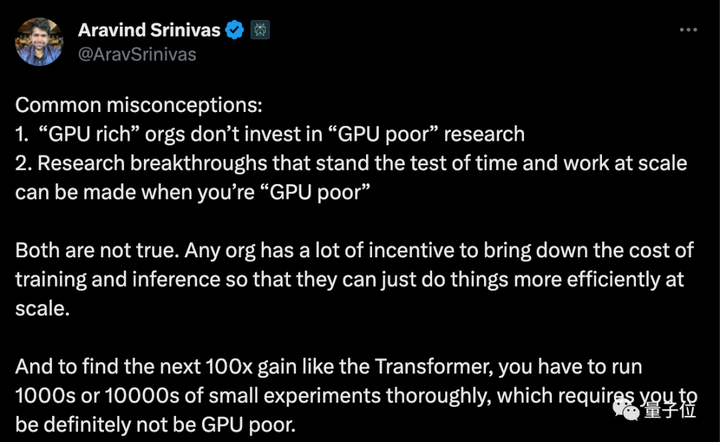

Thấy vậy, một số người cũng đưa ra những ý kiến khác nhau, cho rằng đột phá sáng tạo thường đến từ môi trường hạn chế là một lợi thế.

Và để tìm ra bước đột phá tiếp theo như Transformer thì cần phải thực hiện hàng nghìn thí nghiệm và nguồn lực cần thiết chắc chắn không thấp.

Cách chơi game “GPU bạo chúa cục bộ”

Vậy phía bên kia dân thường GPU, Google, “ông trùm GPU” đang làm gì? .

Nói đúng ra, sức mạnh tính toán của Google không phải là GPU mà là TPU của chính họ. Báo cáo tin rằng mặc dù hiệu suất đơn vị của TPUv5 không tốt bằng NVIDIA H100 nhưng Google có kiến trúc cơ sở hạ tầng hiệu quả nhất.

Sau khi sáp nhập Google Brain và DeepMind, họ đã cùng nhau huấn luyện mô hình Gemini chống lại GPT-4.

Nhóm gồm 100 người được dẫn dắt bởi hai cựu Phó chủ tịch nghiên cứu DeepMind Koray Kavukcuoglu và Oriol Vinyals và cựu giám đốc Google Brain Jeff Dean.

Gemini sẽ tích hợp khả năng của các mô hình lớn và tạo hình ảnh AI, sử dụng 9,36 tỷ phút đào tạo phụ đề video trên Youtube và tổng kích thước tập dữ liệu ước tính gấp đôi so với GPT-4.

Cựu người sáng lập DeepMind Hassabis đã tiết lộ rằng Gemini sẽ kết hợp một số khả năng của hệ thống loại AlphaGo với “những cải tiến rất thú vị khác”.

Ngoài ra, người sáng lập Google Brin còn đích thân tham gia vào hoạt động nghiên cứu và phát triển của Gemini, bao gồm cả việc đánh giá mô hình và hỗ trợ đào tạo.

Không có nhiều tin tức cụ thể hơn về Gemini, nhưng một số người suy đoán rằng nó cũng sẽ sử dụng kiến trúc MoE và công nghệ lấy mẫu suy đoán giống như GPT-4.

Một bài báo mới, Từ hỗn hợp thưa thớt đến mềm mại của các chuyên gia do Google DeepMind xuất bản vào đầu tháng 8, được coi là có thể liên quan đến Song Tử.

Cụ thể, hãy để mô hình nhỏ tạo trước một số mã thông báo và để mô hình lớn đưa ra đánh giá, nếu được chấp nhận, hãy để mô hình lớn tạo mã thông báo tiếp theo và lặp lại bước đầu tiên. Nếu chất lượng của mô hình nhỏ không cao, sau đó chuyển sang mô hình lớn.

Tài liệu lấy mẫu suy đoán của Google sẽ không được xuất bản cho đến tháng 11 năm 2022, nhưng những tiết lộ trước đó cho thấy GPT-4 cũng sử dụng công nghệ tương tự.

Noam Shazeer đã tham gia nghiên cứu về Transformer, MoE và lấy mẫu suy đoán khi còn ở Google, những điều này rất quan trọng đối với các mô hình lớn hiện nay. Ngoài ra, anh còn tham gia nghiên cứu nhiều mô hình lớn như T5, LaMDA và PaLM .

Báo cáo của SemiAnalysis cũng kể một mẩu tin đồn về anh ấy.

Ngay từ thời GPT-2, Noam Shazeer đã viết một bản ghi nhớ nội bộ tại Google, dự đoán rằng các mô hình lớn sẽ được tích hợp vào cuộc sống của con người theo nhiều cách khác nhau trong tương lai, nhưng quan điểm này không được Google coi trọng vào thời điểm đó.

Bây giờ có vẻ như nhiều điều anh ấy dự đoán đã thực sự xảy ra sau khi ChatGPT phát hành.

Tuy nhiên, Noam Shazeer đã rời Google để thành lập Character.ai vào năm 2021. Theo báo cáo này, anh hiện cũng thuộc nhóm “người nghèo GPU”.

Liên kết tham khảo: [1] [2] [3] [4]