Велике модельне коло гаряче обговорює «поганий графічний процесор»: стало відомо, що Google має більшу обчислювальну потужність, ніж інші компанії разом узяті, що турбує стартапи.

Джерело: Qubits

Коли я прокинувся однієї ночі, у великих модельних колах точилася гаряча дискусія - “Поганий GPU” (GPU-Poor).

У звіті SemiAnalysis, галузевої аналітичної організації, виявлено, що Google має більше обчислювальних ресурсів, ніж OpenAI, Meta, Amazon, Oracle і CoreWeave разом узяті.

Аналітик Ділан Патель прогнозує, що до кінця року масштабна модель наступного покоління Gemini, спільно розроблена Google DeepMind, розгромить (Smash) GPT-4 і досягне 5 разів більшого значення останнього.

У звіті наголошується, що перед обличчям цієї переважної переваги більшість стартапів і компаній з відкритим кодом стали «бідними на GPU» і борються з обмеженими ресурсами.

Це привертає увагу і розриває серце твердження швидко стало новим стеблом і поширилося в галузі.

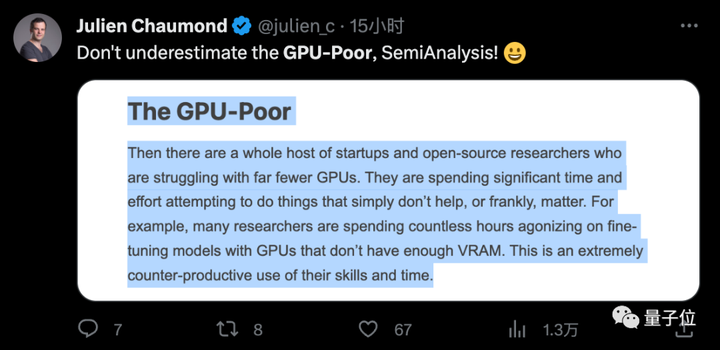

Жюльєн Шомон, співзасновник HuggingFace, визнаного лідера відкритого коду, сказав: «Не недооцінюйте нас, бідних людей».

“Поганий GPU” робить марну роботу

Звіт дуже безжальний і прямо стверджує, що багато стартапів витрачають багато часу та енергії, роблячи марні речі, коли їм не вистачає графічних процесорів.

Наприклад, багато людей прагнуть використати вихідні дані великої моделі для точного налаштування маленької моделі, а потім перейти до перегляду таблиці лідерів, але метод оцінки не ідеальний і приділяє більше уваги стиль, ніж точність чи практичність.

Доповідь також вважає, що самі рейтинги з недосконалими стандартами вимірювання також вводять в оману малі компанії, що призводить до великої кількості непрактичних моделей, що також шкодить руху відкритого коду.

З іншого боку, бідні люди з GPU не використовують ресурси ефективно, і більшість із них використовують щільні моделі, які в основному базуються на екосистемі alpaca з відкритим кодом.

Але такі гіганти, як OpenAI і Google, уже грають із розрідженими моделями**, такими як архітектура MoE, і використовують малі моделі** спекулятивної вибірки (спекулятивного декодування) для підвищення ефективності міркувань, що є двома абсолютно різними іграми**.

Автор сподівається, що бідні люди з GPU не повинні надмірно обмежувати розмір моделі та надмірну кількісну оцінку, ігноруючи при цьому погіршення якості моделі. Він має зосередитися на ефективному створенні точно налаштованих моделей на спільній інфраструктурі, зменшенні затримки та вимог до пропускної здатності пам’яті для задоволення потреб периферійних обчислень.

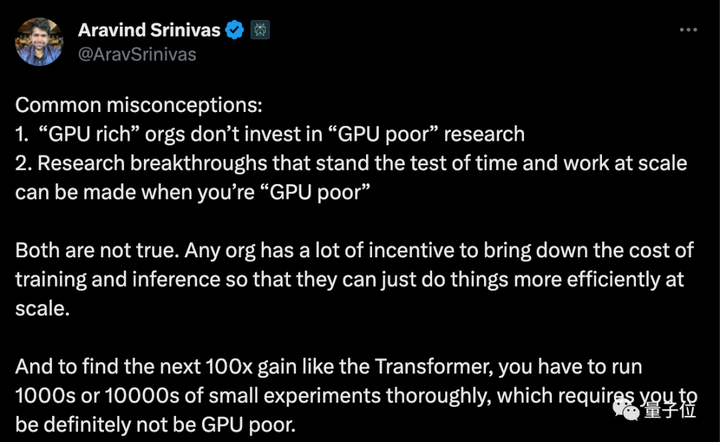

Бачачи це, деякі люди також висувають різні думки, вважаючи, що творчі прориви часто відбуваються в обмеженому середовищі, що є перевагою.

І щоб знайти такий наступний прорив, як Transformer, потрібні тисячі експериментів, а потрібні ресурси точно немалі.

Як грати в гру «GPU local tyrant»

То що ж робить інша сторона цивільних осіб ГПУ, Google, «магнат ГПУ»,? .

Строго кажучи, обчислювальна потужність Google — це не GPU, а власний TPU. Згідно зі звітом, хоча продуктивність TPUv5 не така хороша, як у Nvidia H100, Google має найефективнішу інфраструктуру.

Після злиття Google Brain і DeepMind вони спільно навчили модель Gemini проти GPT-4.

Команду зі 100 осіб спільно очолюють два колишніх віце-президенти з досліджень DeepMind Корай Кавукчуоглу та Оріол Віньялс і колишній керівник Google Brain Джефф Дін.

Gemini об’єднає можливості великих моделей і створення зображень штучним інтелектом, використовуючи 9,36 мільярда хвилин навчання субтитрів відео на Youtube, а загальний розмір набору даних оцінюється вдвічі більше, ніж у GPT-4.

Колишній засновник DeepMind Хассабіс розповів, що Gemini поєднає деякі можливості системи типу AlphaGo з «іншими дуже цікавими інноваціями».

Крім того, засновник Google Брін також брав особисту участь у розробці Gemini, включаючи оцінку моделі та допомогу в навчанні.

Більш конкретних новин про Gemini немає, але деякі люди припускають, що він також використовуватиме ту саму архітектуру MoE та технологію спекулятивної вибірки, що й GPT-4.

Новий документ From Sparse to Soft Mixtures of Experts, опублікований Google DeepMind на початку серпня, вважається потенційно пов’язаним з Gemini.

Зокрема, нехай мала модель згенерує декілька токенів заздалегідь, а велика модель винесе рішення. Якщо воно прийнято, нехай велика модель згенерує наступний токен і повторить перший крок. Якщо якість малої моделі невисока, потім перейдіть на велику модель.

Стаття про спекулятивну вибірку Google була опублікована лише в листопаді 2022 року, але попередні звіти припускали, що GPT-4 також використовувала подібну технологію.

Ноам Шазір брав участь у дослідженнях Transformer, MoE та спекулятивної вибірки, коли він працював у Google, які є ключовими для сучасних великих моделей. Крім того, він також брав участь у дослідженні багатьох великих моделей, таких як T5, LaMDA та PaLM.

У звіті SemiAnalysis також розповіли одну зі своїх пліток.

Ще в епоху GPT-2 Ноам Шазір написав внутрішню записку в Google, передбачаючи, що великі моделі будуть інтегровані в життя людей різними способами в майбутньому, але ця точка зору не була сприйнята серйозно Google у той час.

Тепер здається, що багато речей, які він передбачив, насправді відбулися після випуску ChatGPT.

Однак Ноам Шазір покинув Google, щоб створити Character.ai у 2021 році. Згідно з цим звітом, тепер він також є частиною «бідних GPU».

Довідкові посилання: [1] [2] [3] [4]