Da curva de referência ao ciclo fechado de I&D: avaliação objetiva da probabilidade de "IA Recursive Self-Improvement" antes de 2028

Porque é que uma “probabilidade de 60%” merece análise séria

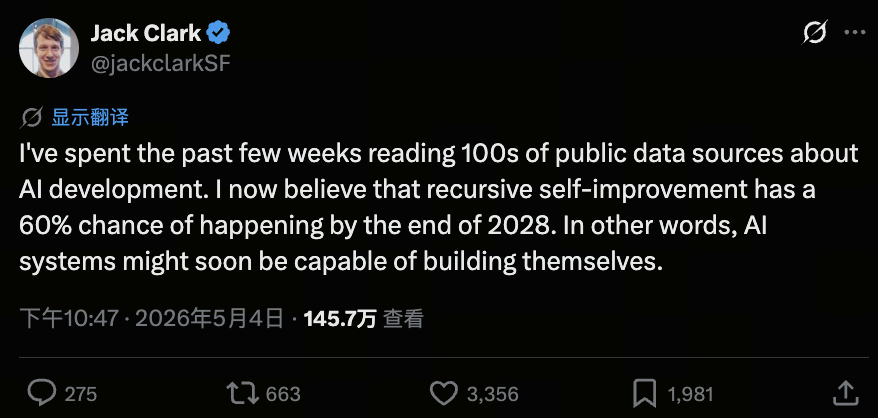

Fonte da imagem: Anthropic Co-Founder Tweet

Fonte da imagem: Anthropic Co-Founder Tweet

Nas discussões sobre IA, as conclusões surgem frequentemente em destaque, relegando o raciocínio subjacente para segundo plano. Esta tendência é particularmente evidente nos debates sobre Recursive Self-Improvement (RSI). À primeira vista, o foco está numa afirmação ousada: até 2028, existe uma probabilidade significativa de que a IA alcance capacidades de I&D auto-reforçadas. O verdadeiro desafio, porém, reside em determinar se já foram observados sinais precoces “sistemáticos” suficientes para que este cenário passe de hipótese marginal a risco central, exigindo resposta dos decisores institucionais.

Esta questão é determinante para políticas e para o setor, pois RSI não é apenas um “mito da inteligência geral”. É um desafio de engenharia: pode a IA assumir progressivamente mais etapas de elevado valor em fluxos de trabalho de I&D e conectá-las num ciclo fechado iterativo? Com a existência desse ciclo, o ritmo do progresso tecnológico altera-se, as lacunas de capacidade organizacional redefinem-se e os ciclos regulatórios tradicionais são postos em causa.

O debate sobre RSI deve, assim, ultrapassar a dicotomia “crer ou não crer” e centrar-se na robustez das evidências, prudência das extrapolações e adequação das preparações.

Base de evidências: valor e limites do progresso consistente em múltiplos benchmarks

A principal evidência que sustenta a RSI não é o avanço isolado de um modelo, mas o progresso sincronizado em tarefas, cenários e estruturas de avaliação. Benchmarks como reprodutibilidade de investigação, otimização pós-treino, resolução de problemas competitivos reais e desafios de engenharia de software revelam tendências ascendentes, em diferentes graus. O valor reside na “consistência direcional”, não apenas nos “valores absolutos”: quando vários indicadores proxy evoluem em simultâneo, sinalizam um reforço generalizado das capacidades subjacentes.

No entanto, existem três limitações essenciais:

-

Os ambientes de benchmark são distintos do contexto real. Benchmarks apresentam limites definidos, feedback estável e critérios repetíveis. Na prática de I&D, surgem desvios de objetivos, colaboração entre equipas, transferência tácita de conhecimento, restrições de recursos e fricção institucional. O êxito em ambientes controlados não garante resultados organizacionais fiáveis.

-

Métricas visíveis não refletem capacidade total. Os benchmarks atuais avaliam mais facilmente a “capacidade de resolução de problemas”, mas captam de forma incompleta comportamentos de I&D de ordem superior—como definição de problemas, gestão de prioridades, atribuição de falhas e governança inter-cíclica. Ou seja, os modelos podem melhorar na “resolução dos problemas certos”, mas não necessariamente na “execução consistente das ações corretas”.

-

A extrapolação de tendências pode ser afetada pela migração de estrangulamentos. A história demonstra que o progresso tecnológico raramente é linear. Ao superar-se um estrangulamento, surgem outros—em qualidade de dados, custos de hash rate, fiabilidade do sistema, conformidade ou aceitação social. Ignorar estas restrições secundárias pode levar a sobrestimar o progresso e a subestimar resistências.

O progresso consistente em múltiplos benchmarks é, assim, um sinal relevante, mas não uma prova definitiva. Indica que a “direção importa”, sem fixar um “calendário”.

A clivagem central: ganhos de capacidade conseguem fechar o ciclo?

O verdadeiro debate sobre RSI não é se a “IA está a evoluir”, mas se “os ganhos são suficientes para formar um ciclo fechado”. Um ciclo fechado autêntico integra pelo menos cinco etapas sequenciais: recolha de informação e revisão de literatura, geração de hipóteses, conceção e execução de experiências, avaliação de resultados e diagnóstico de erros, atualização de estratégia e reiteração. Melhorar uma etapa aumenta a eficiência, mas apenas a integração sólida entre etapas gera retornos compostos.

Neste momento, o progresso é mais evidente nas três primeiras e parte da quarta: os modelos são cada vez mais eficientes na geração de código, automatização de experiências, síntese de literatura e pesquisa de parâmetros. Os maiores desafios do ciclo fechado residem em duas capacidades:

-

Diagnóstico robusto: o sistema consegue identificar causas-raiz em dados ruidosos, sinais contraditórios ou falhas esporádicas, em vez de aplicar apenas correções superficiais?

-

Alinhamento de objetivos: o sistema executa de forma consistente estratégias “eficazes a longo prazo mas subótimas a curto prazo” sob múltiplas restrições, ou limita-se a maximizar pontuações locais?

Por isso, “conseguir fazer” não equivale a “ser responsabilizável”. Um ciclo fechado de I&D resulta da conjugação de tecnologia, desenho de processos e estruturas de responsabilidade. Sem mecanismos claros de responsabilização e auditoria, as organizações terão dificuldade em delegar autoridade de forma segura, mesmo que a tecnologia esteja quase pronta.

Calibração metodológica: probabilidade, análise de cenários e limiares de decisão

A expressão “60% até 2028” é útil para comunicar—obriga a reconhecer que o horizonte temporal pode ser mais curto do que o previsto. No entanto, em contexto de decisão, estes valores devem ser vistos como probabilidades subjetivas, não estimativas estatísticas precisas. Uma abordagem mais útil consiste em converter probabilidades pontuais numa estrutura de “cenário-limiar”.

Três níveis de cenário são relevantes:

-

Base: IA profundamente integrada no I&D, mas decisões-chave continuam humanas—modelo de “elevada automação, fallback humano”.

-

Aceleração: IA alcança iteração quase em ciclo fechado em vários domínios, encurtando drasticamente ciclos de I&D e conferindo vantagens compostas aos líderes.

-

Alto impacto: capacidades de ciclo fechado entre domínios emergem, a iteração do modelo supera a adaptação regulatória e as pressões de governança intensificam-se.

Para cada cenário, definir métricas-limiar claras em vez de discutir anos específicos. Exemplos: duração de iteração contínua sem supervisão, taxa de sucesso de transferência entre tarefas, taxa de recall na deteção de anomalias, taxa de sucesso de auto-reversão e proporção de intervenção manual nos pontos-chave. Quando os limiares são atingidos, desencadeiam-se ações de governança; quando descem, as restrições são aliviadas. Esta abordagem torna previsões abstratas em gestão acionável.

Impacto no setor: como as organizações de I&D serão transformadas

Com RSI ou quase-RSI, a competição desloca-se da “performance do modelo” para “operações em ciclo fechado”. O sucesso dependerá menos da dimensão do modelo e mais da capacidade de construir ciclos de I&D mais curtos, estáveis e controláveis nas organizações reais.

Os limites organizacionais serão redefinidos. Os processos tradicionais de I&D—sequência de funções especializadas—evoluirão para redes colaborativas de “poucos elementos-chave + afiliados de IA em larga escala”. As funções não desaparecem; migram para orquestração de sistemas, controlo de qualidade e governança de risco.

Os ganhos de eficiência serão não lineares. Organizações que automatizarem processos primeiro podem conquistar vantagens geracionais em velocidade de iteração, estrutura de custos e escala de experimentação. Quem introduzir IA apenas em áreas isoladas verá melhorias incrementais—com dificuldade em fechar lacunas estruturais.

A “capacidade de I&D fiável” será o novo fosso competitivo. O valor competitivo futuro não será apenas ser “rápido”, mas “rápido e comprovadamente seguro”. Registos rastreáveis, experiências reproduzíveis, auditorias de mudança estratégica e sistemas de resposta a incidentes deixam de ser custos de conformidade para se tornarem ativos de confiança de mercado.

Agenda de governança: desenho institucional para controlabilidade na aceleração

Com a aceleração, a governança não deve travar o progresso, mas garantir “controlabilidade verificável”. Isto exige evolução técnica e institucional em paralelo.

Tecnicamente, a segurança deve ser integrada no pipeline de I&D: registo automático de decisões-chave, dupla aprovação para ações de alto risco, limites de sandbox para auto-modificação do modelo e revisão obrigatória de saltos anómalos de performance. O princípio essencial: “observabilidade antes da delegação”.

Institucionalmente, adotar governança escalonada—não regras uniformes. Flexibilidade para aplicações de baixo risco, maior transparência e responsabilidade para sistemas de alto impacto, com mecanismos de atualização dinâmica. Regras estáticas não acompanham a iteração rápida; a regulação tem de se “recalibrar continuamente”.

A nível organizacional, os “pontos de responsabilidade humana” devem ser explícitos. Quando a IA participa em decisões de I&D e implementação, os pontos-chave exigem signatários humanos identificáveis e responsáveis. Automatizar sem ancoragem de responsabilidade só aumenta a velocidade, não a qualidade.

Conclusão: navegar a era RSI com “vigilância elevada, certeza baixa”

Regressando à questão central: esta perspetiva é válida? A direção é válida, mas a expressão deve ser cautelosa. É válida porque evidencia o avanço da IA em múltiplas dimensões de I&D, podendo o ponto de viragem do ciclo fechado surgir mais cedo do que o esperado. A cautela é fundamental, pois qualquer data ou probabilidade envolve pressupostos subjetivos e tende a subestimar a fricção real.

Para os decisores, a melhor estratégia não é oscilar entre otimismo e pessimismo, mas construir resiliência perante a incerteza:

Por um lado, preparar-se para que a aceleração “possa ocorrer mais cedo”, evitando respostas passivas em momentos críticos. Por outro, limitar a expansão do sistema com cenários em camadas, limiares quantificáveis e pontos de responsabilidade, assegurando que o crescimento de capacidades permanece controlável.

Se a última fase da IA consistiu em “permitir que as máquinas realizem tarefas”, a próxima, mais decisiva, será: à medida que as máquinas começam a ajudar a criar a geração seguinte de máquinas, conseguirá a humanidade evoluir os seus sistemas de governança e responsabilidade ao mesmo ritmo?

Não se trata apenas de um desafio de previsão técnica—é uma redefinição da ordem futura da inovação.

Artigos relacionados

Tokenomics do USD.AI: análise aprofundada dos casos de utilização do token CHIP e dos mecanismos de incentivos

Análise das Fontes de ganhos de USD.AI: como os empréstimos de infraestrutura de IA geram retorno

A aplicação da Render em IA: como o hashrate descentralizado potencia a inteligência artificial

Render, io.net e Akash: análise comparativa das redes DePIN de poder de hash

Análise da arquitetura do protocolo Audiera: funcionamento dos sistemas económicos nativos para agentes