Dari Baseline Curve menuju R&D Closed Loop: Evaluasi objektif terhadap kemungkinan "AI Recursive Self-Improvement" sebelum 2028

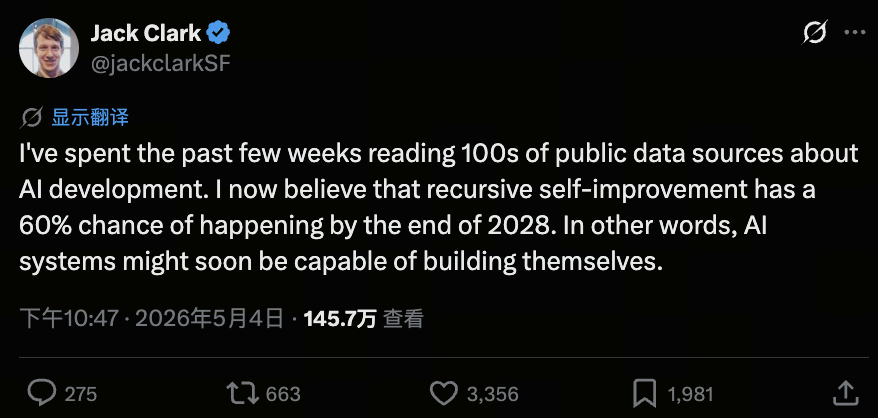

Mengapa "Probabilitas 60%" Layak Dipertimbangkan Serius

Sumber gambar: Tweet Co-Founder Anthropic

Sumber gambar: Tweet Co-Founder Anthropic

Dalam diskusi AI, kesimpulan sering menjadi sorotan utama, sementara alasan di baliknya kerap terabaikan. Hal ini sangat nyata dalam perdebatan mengenai Recursive Self-Improvement (RSI). Di permukaan, perdebatan utama adalah klaim berani: pada 2028, terdapat probabilitas signifikan AI akan mencapai kapabilitas R&D yang memperkuat diri sendiri. Namun, isu yang lebih mendalam adalah apakah kita telah melihat cukup banyak "sinyal awal sistematis" untuk memindahkan skenario ini dari hipotesis pinggiran menjadi risiko inti yang wajib diantisipasi para pengambil keputusan utama.

Pertanyaan ini sangat relevan bagi kebijakan dan industri, sebab RSI bukan sekadar "mitos kecerdasan umum" yang abstrak. RSI adalah tantangan rekayasa: bisakah AI mengambil semakin banyak langkah bernilai tinggi dalam alur kerja R&D, lalu menghubungkan langkah-langkah itu menjadi siklus tertutup yang terus berulang? Jika siklus ini terbentuk, laju kemajuan teknologi berubah, kesenjangan kapabilitas organisasi terdefinisi ulang, dan siklus regulasi tradisional terganggu.

Karena itu, perdebatan RSI harus melampaui sekadar "percaya atau tidak percaya" dan berfokus pada kecukupan bukti, kehati-hatian ekstrapolasi, serta kesiapan mitigasi.

Basis Bukti: Nilai dan Batasan Progres Multi-Benchmark yang Konsisten

Bukti terkuat RSI bukanlah terobosan satu model, melainkan progres serempak di berbagai tugas, skenario, dan kerangka evaluasi. Benchmark yang sering dikutip—reproduksibilitas penelitian, optimisasi pasca-pelatihan, pemecahan masalah kompetisi dunia nyata, dan tantangan rekayasa perangkat lunak—semuanya menunjukkan tren kenaikan dalam berbagai tingkat. Nilai utamanya terletak pada "konsistensi arah," bukan hanya "nilai absolut": ketika sejumlah metrik proksi meningkat bersama dari waktu ke waktu, ini menandakan peningkatan kapabilitas mendasar secara luas.

Namun, ada tiga keterbatasan utama:

-

Lingkungan benchmark berbeda dari dunia nyata. Benchmark memiliki batas yang jelas, umpan balik stabil, dan standar evaluasi yang konsisten. Dalam R&D nyata, Anda menghadapi perubahan tujuan, kolaborasi lintas tim, transfer pengetahuan implisit, keterbatasan sumber daya, dan friksi institusional. Keberhasilan di lingkungan terkontrol tidak otomatis berarti output organisasi yang andal.

-

Visibilitas metrik tidak sama dengan kapabilitas penuh. Benchmark saat ini lebih mudah mengukur "kemampuan pemecahan masalah," namun sulit menangkap perilaku R&D tingkat tinggi—seperti pendefinisian masalah, prioritas, atribusi kegagalan, dan tata kelola lintas siklus. Artinya, model dapat lebih baik dalam "memecahkan masalah yang tepat," tetapi belum tentu "konsisten melakukan hal yang benar."

-

Ekstrapolasi tren dapat terganggu oleh perpindahan bottleneck. Sejarah menunjukkan kemajuan teknologi tidak selalu linier. Setelah satu bottleneck teratasi, bottleneck baru bisa muncul pada kualitas data, biaya hash rate, keandalan sistem, kepatuhan, atau penerimaan sosial. Mengabaikan kendala tingkat dua ini bisa menyebabkan perkiraan kemajuan berlebihan dan meremehkan hambatan.

Dengan demikian, progres multi-benchmark yang konsisten merupakan sinyal kuat, namun bukan bukti mutlak. Ini menegaskan bahwa "arahnya penting," bukan bahwa "linimasa sudah pasti."

Perbedaan Inti: Bisakah Peningkatan Kapabilitas Menutup Kesenjangan Siklus Tertutup?

Perdebatan utama RSI bukanlah sekadar "AI makin kuat," melainkan "apakah peningkatannya cukup membentuk siklus tertutup." Siklus tertutup sejati melibatkan setidaknya lima langkah berurutan: pengambilan informasi dan tinjauan literatur, generasi hipotesis, desain dan eksekusi eksperimen, evaluasi hasil dan diagnosis kesalahan, serta pembaruan strategi dan pengulangan. Meningkatkan satu langkah memang menambah efisiensi, tetapi hanya integrasi kokoh antar-langkah yang menghasilkan keuntungan berlipat.

Saat ini, kemajuan terutama terlihat pada tiga langkah pertama dan sebagian langkah keempat: model semakin efisien dalam pembuatan kode, skrip eksperimen, ringkasan literatur, dan pencarian parameter. Bagian tersulit dari siklus tertutup biasanya bergantung pada dua kapabilitas:

-

Diagnosis yang kokoh: Bisakah sistem secara akurat mengidentifikasi akar masalah di tengah data bising, sinyal bertentangan, atau kegagalan sporadis, bukan sekadar memperbaiki permukaan?

-

Penyelarasan tujuan: Bisakah sistem secara konsisten menjalankan strategi "efektif jangka panjang namun suboptimal jangka pendek" dalam berbagai batasan, bukan sekadar memaksimalkan skor lokal?

Itulah sebabnya "bisa melakukan" tidak berarti "bisa bertanggung jawab." Siklus R&D tertutup bukan sekadar jumlah kapabilitas model—melainkan produk dari teknologi, desain proses, dan struktur tanggung jawab. Tanpa akuntabilitas dan mekanisme audit yang jelas, organisasi akan kesulitan mendelegasikan kewenangan secara aman, meski teknologinya hampir siap.

Kalibrasi Metodologis: Probabilitas, Analisis Skenario, dan Ambang Keputusan

Pernyataan "60% pada 2028" berguna untuk komunikasi—memaksa publik menyadari bahwa jendela waktu mungkin lebih singkat dari dugaan. Namun untuk pengambilan keputusan, angka seperti ini sebaiknya dipandang sebagai probabilitas subjektif, bukan estimasi statistik presisi. Pendekatan yang lebih praktis adalah mengubah probabilitas titik menjadi kerangka "skenario-ambang batas."

Tiga level skenario yang relevan:

-

Baseline: AI terintegrasi dalam R&D, tetapi manusia tetap mengambil keputusan kunci—model "otomasi tinggi, fallback manusia."

-

Akselerasi: AI mencapai iterasi quasi-siklus tertutup di beberapa domain, memperpendek siklus R&D secara tajam dan memberikan keunggulan berlipat kepada pemimpin.

-

Dampak tinggi: Kapabilitas siklus tertutup lintas domain muncul, iterasi model melampaui adaptasi regulasi, dan tekanan tata kelola meningkat.

Untuk setiap skenario, tetapkan metrik ambang batas yang jelas, bukan memperdebatkan tahun tertentu. Contohnya: durasi iterasi berkelanjutan tanpa pengawasan, tingkat keberhasilan transfer lintas tugas, tingkat recall deteksi anomali, tingkat keberhasilan auto-rollback, dan proporsi intervensi manual pada node kunci. Saat ambang tercapai, aksi tata kelola dipicu; saat turun, pembatasan dilonggarkan. Pendekatan ini mengubah prediksi abstrak menjadi manajemen yang dapat dijalankan.

Dampak Industri: Bagaimana Organisasi R&D Akan Bertransformasi

Jika RSI atau quasi-RSI terwujud, persaingan industri akan bergeser dari "performa model" ke "operasi siklus tertutup." Pemenang bukan lagi yang memiliki model terbesar, melainkan yang mampu membangun siklus R&D lebih singkat, stabil, dan terkontrol di organisasi nyata.

Batas organisasi akan bergeser. Proses R&D tradisional—sebelumnya urutan peran spesialis—akan menjadi jaringan kolaboratif "beberapa orang kunci + afiliasi AI skala besar." Peran tidak hilang, melainkan bermigrasi ke orkestrasi sistem, kendali mutu, dan tata kelola risiko.

Peningkatan efisiensi akan nonlinier. Organisasi yang lebih dulu mengotomasi proses dapat meraih keunggulan generasi dalam kecepatan iterasi, struktur biaya, dan skala eksperimen. Yang hanya mengadopsi AI di area terpisah akan melihat peningkatan linier dan bertahap—berjuang menutup kesenjangan struktural.

"Kapabilitas R&D yang dapat dipercaya" akan menjadi parit kompetitif baru. Daya saing bernilai tinggi masa depan bukan sekadar "cepat," tetapi "cepat dan terbukti aman." Log yang dapat dilacak, eksperimen yang dapat direproduksi, audit perubahan strategi, dan sistem respons insiden akan bertransformasi dari biaya kepatuhan menjadi aset kepercayaan pasar.

Agenda Tata Kelola: Desain Institusional untuk Kontrolabilitas Saat Akselerasi

Saat akselerasi menjadi mungkin, tata kelola tidak bertujuan menghentikan kemajuan, melainkan membangun "kontrolabilitas yang dapat diverifikasi." Ini membutuhkan kemajuan tata kelola teknis dan institusional secara paralel.

Secara teknis, aspek keamanan harus terintegrasi dalam pipeline R&D: pencatatan otomatis keputusan kunci, persetujuan ganda untuk aksi berisiko tinggi, batas sandbox untuk modifikasi mandiri model, dan tinjauan wajib atas lonjakan performa anomali. Prinsip utamanya: "observabilitas sebelum pendelegasian."

Secara institusional, terapkan tata kelola bertingkat—bukan satu aturan untuk semua. Beri fleksibilitas untuk aplikasi risiko rendah, namun tuntut transparansi dan akuntabilitas lebih tinggi untuk sistem berdampak besar, dengan mekanisme pembaruan dinamis. Aturan statis tak bisa mengikuti iterasi cepat; regulasi harus mampu "terkalibrasi ulang secara berkelanjutan."

Secara organisasi, "jangkar tanggung jawab manusia" harus eksplisit. Ketika AI terlibat dalam keputusan R&D dan deployment, titik kunci harus memiliki penandatangan manusia yang dapat diidentifikasi dan bertanggung jawab. Otomasi tanpa jangkar tanggung jawab hanya menambah kecepatan, bukan kualitas.

Kesimpulan: Menavigasi Era RSI dengan "Kewaspadaan Tinggi, Kepastian Rendah"

Kembali ke pertanyaan utama: apakah perspektif ini valid? Arahnya valid, namun ekspresinya harus hati-hati. Valid karena menyoroti bahwa AI berkembang di banyak dimensi R&D, dan titik kritis siklus tertutup bisa datang lebih cepat dari perkiraan. Kehati-hatian penting, sebab tanggal atau probabilitas spesifik pasti melibatkan asumsi subjektif dan cenderung meremehkan hambatan dunia nyata.

Bagi pengambil keputusan, pendekatan terbaik bukan berayun antara optimisme dan pesimisme, melainkan membangun resiliensi di tengah ketidakpastian:

Di satu sisi, bersiaplah seolah akselerasi "bisa terjadi lebih cepat," hindari respons pasif di saat krusial. Di sisi lain, batasi ekspansi sistem dengan skenario berlapis, ambang batas terukur, dan jangkar tanggung jawab, agar pertumbuhan kapabilitas tetap terjaga.

Jika fase terakhir AI adalah tentang "membuat mesin menyelesaikan tugas," pertanyaan berikutnya yang lebih penting adalah: saat mesin mulai membantu menciptakan generasi mesin berikutnya, bisakah manusia ikut mengembangkan sistem tata kelola dan tanggung jawabnya?

Ini bukan sekadar tantangan prediksi teknis—melainkan soal mendefinisikan ulang tatanan masa depan inovasi.

Artikel Terkait

Tokenomik USD.AI: Analisis Kedalaman Kasus Penggunaan Token CHIP dan Mekanisme Insentif

Analisis Sumber Keuntungan USD.AI: Cara Pinjaman Infrastruktur AI Menghasilkan Keuntungan

Analisis Arsitektur Audiera Protocol: Cara Kerja Sistem Ekonomi Agent-Native

Analisis Kedalaman Audiera GameFi: Cara Dance-to-Earn Memadukan AI dengan Permainan Ritme

Apa Itu Fartcoin? Semua Hal yang Perlu Anda Ketahui Tentang FARTCOIN